Помощник

|

|

AParser_Support

AParser_Support

|

25.3.2015, 13:55;

Ответить: AParser_Support 25.3.2015, 13:55;

Ответить: AParser_Support

Сообщение

#82

|

|

|

A-Parser - 1.1.224 - улучшенные возможности по уникализации результатов, множество исправлений

Все возможности новой версии можно протестировать в демо версии A-Parser'а Улучшения

Исправления в связи с изменениями в выдачи

Исправления

-------------------- |

|

|

|

AParser_Support

AParser_Support

|

5.5.2015, 7:02;

Ответить: AParser_Support 5.5.2015, 7:02;

Ответить: AParser_Support

Сообщение

#83

|

|

|

A-Parser - 1.1.247 - новые парсеры поисковиков Ask и Comcast, произвольные шаблоны в конструкторе результатов

Улучшения

Исправления

Исправления в связи с изменениями в выдачи

Сообщение отредактировал AParser_Support - 5.5.2015, 7:03 -------------------- |

|

|

|

AParser_Support

AParser_Support

|

19.5.2015, 11:20;

Ответить: AParser_Support 19.5.2015, 11:20;

Ответить: AParser_Support

Сообщение

#84

|

|

|

Программа LinkAParser - объединение функционала генератора PandoraBox и парсера A-Parser

С помощью данного софта задействованы основные возможности парсера A-Parser при генерации сайтов программой PandoraBox. Обсуждение на форуме A-Parser'а и ссылка на сайт генератора Применяет возможности А-Парсера для:

Понимает какие ключи уже обработаны и не парсит одно и тоже дважды С программой идут готовые пресеты, которые достаточно импортировать и можно запускать генерацию Спаршенные данные программа структурировано раскладывает в файлы и папки Спаршенный текст программа чистит от мусора по множеству признаков В комплекте с программой идет набор дополнительных макросов:

Для работы необходима лицензия парсера A-Parser Enterprise -------------------- |

|

|

|

AParser_Support

AParser_Support

|

27.5.2015, 12:49;

Ответить: AParser_Support 27.5.2015, 12:49;

Ответить: AParser_Support

Сообщение

#85

|

|

|

Сборник рецептов #3: мобильные сайты, несколько парсеров, позиции ключевых слов

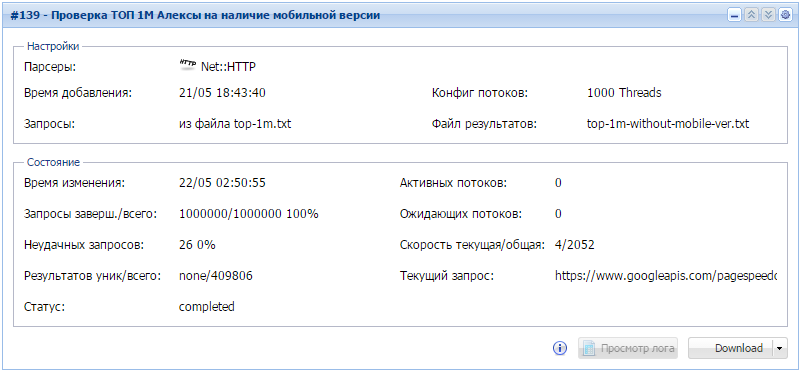

Итак, продолжаем серию статей с рецептами применения A-parser: комплексные примеры с одновременным использованием различного функционала парсера. Проверяем наличие мобильной версии для 1000000 сайтов Работаем с большими объемами данных и учимся искать совпадения в raw data.

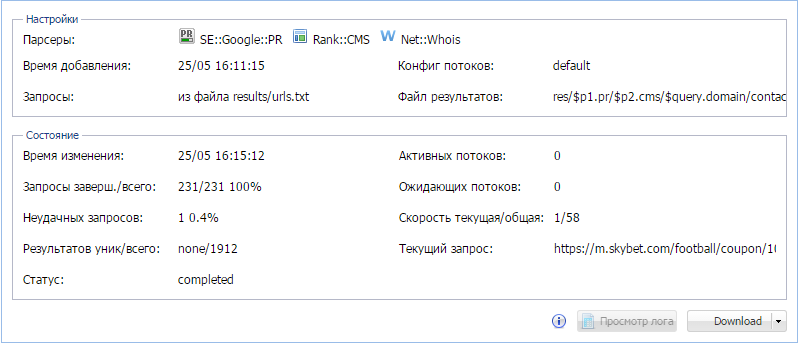

По списку запросов получаем страницы, CMS, PR, e-mail из whois Комплексное задание, выполняемое в 2 этапа, в котором мы учимся работать с несколькими парсерами, регулярными выражениями, а также красиво выводим результаты во многоуровневые каталоги и несколько файлов.

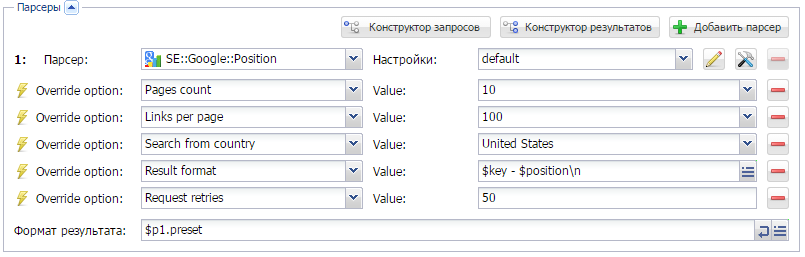

Код PR_1 \Joomla \domain.com contacts.txt cache.txt \Drupal \WordPress \no CMS PR_2 PR_3 Узнать позиции по кеям, как? Знакомимся с парсером  SE::Google::Position и проверяем на каком месте в поисковой выдачи находится ключевое слово. SE::Google::Position и проверяем на каком месте в поисковой выдачи находится ключевое слово. Детальнее о самом парсере здесь. Предыдущие сборники: -------------------- |

|

|

|

AParser_Support

AParser_Support

|

2.6.2015, 13:27;

Ответить: AParser_Support 2.6.2015, 13:27;

Ответить: AParser_Support

Сообщение

#86

|

|

|

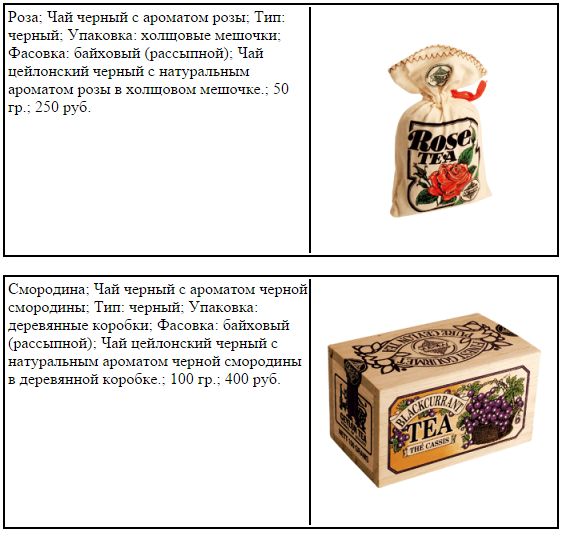

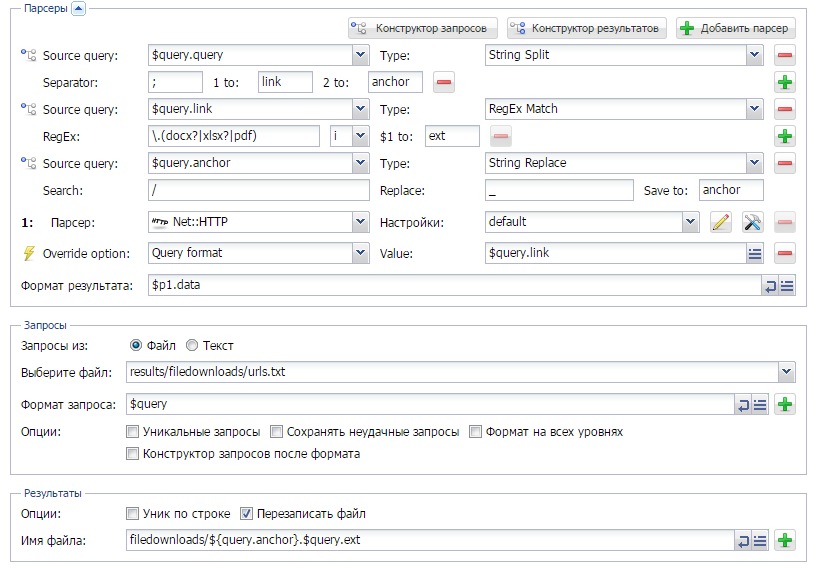

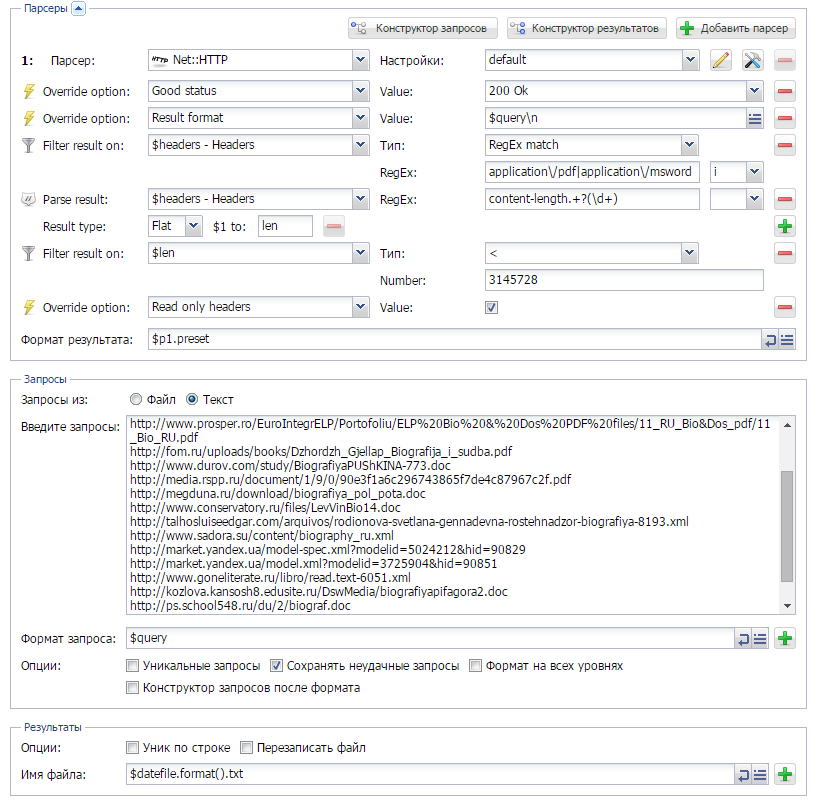

Сборник рецептов #4: поиск в выдаче, парсинг интернет-магазина и скачиваем файлы

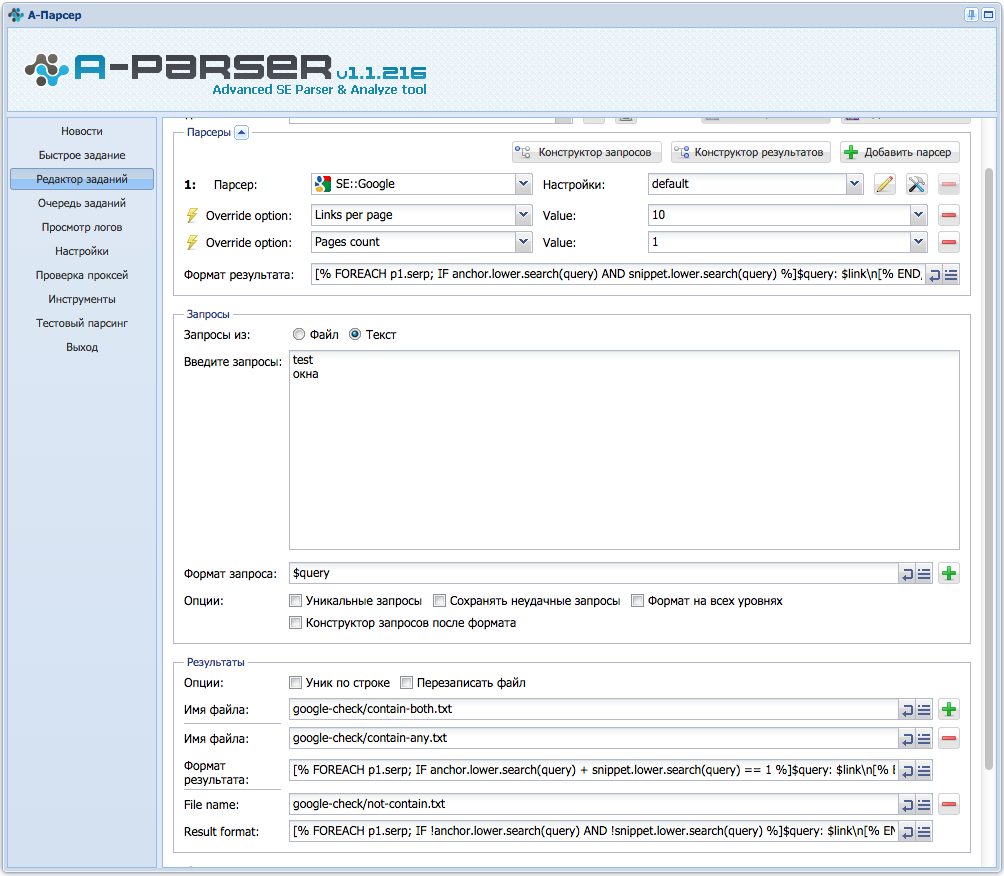

Очередной, 4-й выпуск сборника рецептов. Поехали! Анализ выдачи гугла на наличие ключа в тайтле и дескрипшене Пользуемся возможностями шаблонизатора Template Toolkit. Используем циклы и поиск. А также сохраняем разные результаты в разные файлы.  В данном примере осуществляется поиск ключа в анкорах и сниппетах, и в зависимости от результата, сохраняет их в 1 из 3 соответствующих файлов. Все подробности, а также сохранение в 4-ре файла по ссылке выше. Парсинг товаров с сайта Парсим интернет-магазин и формируем свою HTML-страницу с результатами.  Суть задания заключается в том, чтобы спарсить названия и характеристики товара из интернет-магазина, сохранив привязку к категории и фото товара. Как все это сделать - по ссылке выше. Скачиваем файлы Сохраняем на жесткий диск различные документы из поисковой выдачи, с определением их типа, а также возможностью формировать уникальное имя файла.  Ну а здесь нам необходимо парсить из выдачи Гугла ссылки на документы формата doc, xls и pdf. Так же необходимо скачивать данные документы, при этом обеспечить уникальность имени файла. Детали - по ссылке выше. Предыдущие сборники: -------------------- |

|

|

|

AParser_Support

AParser_Support

|

18.6.2015, 14:17;

Ответить: AParser_Support 18.6.2015, 14:17;

Ответить: AParser_Support

Сообщение

#87

|

|

|

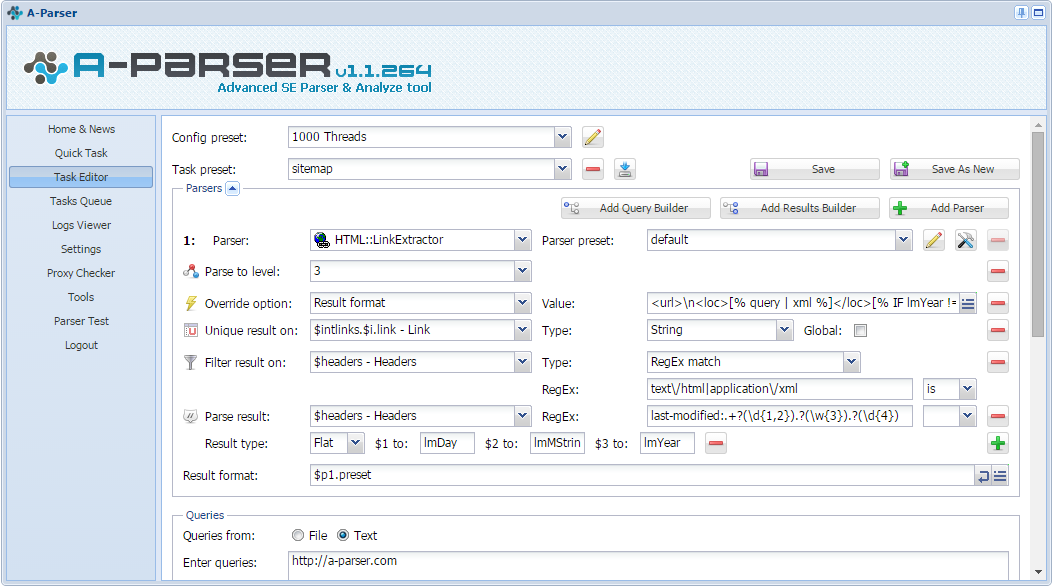

Сборник рецептов #5: ссылки из JS, паблик прокси и карта сайта

5-й выпуск сборника рецептов. Здесь мы научимся парсить ссылки из страниц, где их подгружает JS-скрипт, будем собирать паблик прокси и составлять карту сайта. Подгрузка ссылок через JS Есть очень много сайтов, где контент загружается специальным скриптом (AJAX). К примеру, это может быть поиск на сайте. И как спарсить с таких сайтов информацию? Ведь если посмотреть код страницы в браузере - то, к примеру, ссылки там есть, а парсер их не видит... Решение есть, и оно довольно не сложное. Как это сделать - по ссылке выше.  Сборщик паблик прокси: как лучше и насколько это эффективно Всем известно, что в интернете есть очень много сайтов, где выкладывают публичные прокси (что это на Википедии). Если возникает необходимость в использовании таких прокси - появляется проблема в их сборе, при этом, естественно нужны только живые. Наверное так же известно, что используя А-парсер, можно их собирать. А вот как это делать и насколько это эффективно - читайте по ссылке выше.  Карта сайта с помощью A-parser Карта сайта простыми словами - это XML-файл, который помогает поисковикам лучше индексировать сайт. Некоторые SEOшники считают ее отсутствие грубейшей ошибкой. Существует очень много сервисов и инструментов для создания таких карт, ну а мы попробуем создать ее с помощью A-parser. Что из этого получится, и как это делать - читайте по ссылке выше.  Предыдущие сборники:

-------------------- |

|

|

|

AParser_Support

AParser_Support

|

10.7.2015, 11:24;

Ответить: AParser_Support 10.7.2015, 11:24;

Ответить: AParser_Support

Сообщение

#88

|

|

|

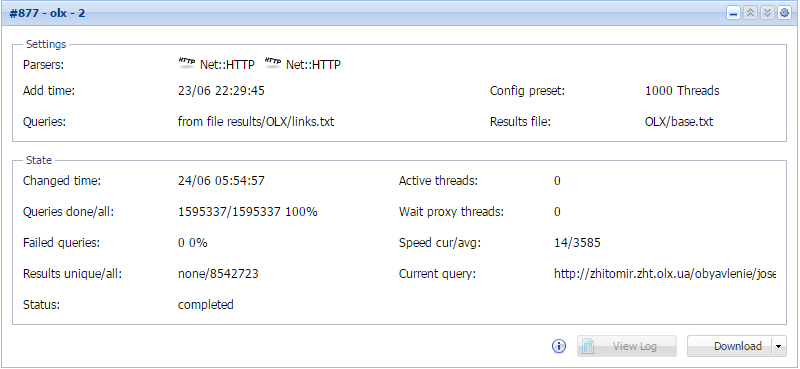

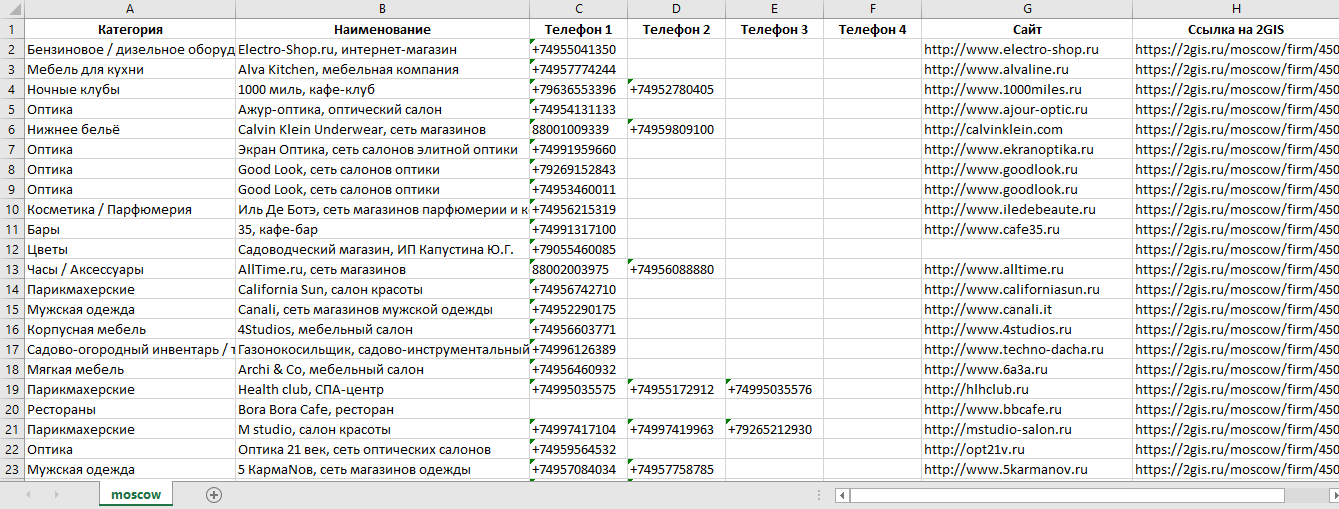

Сборник рецептов #6: парсим базу номеров телефонов и сохраняем результаты красиво

6-й выпуск сборника рецептов. Здесь мы попробуем собирать скрытые номера мобильных телефонов из доски объявлений и научимся сохранять результаты работы А-парсера в таблицы с возможностью сортировки. Парсим базу мобильных телефонов Базы телефонов могут использоваться по-разному, но основной вид их использования - рассылка смс рекламного характера. А если базу еще и возможно отсортировать по городу, интересу или другим характеристикам, т.е. сделать таргетированную рассылку, то эффективность сильно возрастает. Подобные базы собираются разными способами, мы же поговорим о том, как это сделать с помощью А-парсера.  Вывод результатов в таблицу Бывает, возникает необходимость в красивом и удобном выводе данных, полученных в результате парсинга. И если обычного текстового вида недостаточно, нужно искать другие способы вывода. Об одном таком способе и пойдет речь в статье по ссылке выше.  Предыдущие сборники:

-------------------- |

|

|

|

AParser_Support

AParser_Support

|

22.7.2015, 12:58;

Ответить: AParser_Support 22.7.2015, 12:58;

Ответить: AParser_Support

Сообщение

#89

|

|

|

A-Parser - версия 1.1.269 - получение списка задач по API, только мобильные для WordStat

Два месяца у нас работает профессиональный саппорт, который помогает составлять задания любой степени сложности. Доработана документация, регулярно появляются интересные решения на нашем форуме, которые теперь собраны в едином Каталоге примеров. Также создан большой FAQ, в котором собраны ответы на часто задаваемые вопросы. Версия 1.1.269 является одной из последних в ветке 1.1.х, в скором времени будет доступна бета версия 1.2, которая принесет новый виток развития A-Parser, следите за новостями Улучшения

Исправления в связи с изменениями в выдачи

Исправления

Сообщение отредактировал AParser_Support - 22.7.2015, 13:11 -------------------- |

|

|

|

AParser_Support

AParser_Support

|

4.8.2015, 12:23;

Ответить: AParser_Support 4.8.2015, 12:23;

Ответить: AParser_Support

Сообщение

#90

|

|

|

Сборник рецептов #7: парсим RSS, качаем картинки и фильтруем результат по заголовкам

7-й выпуск сборника рецептов. Здесь мы рассмотрим вариант парсинга RSS, будем скачивать картинки в зависимости от их характеристик и научимся фильтровать результат по хедерам. Парсинг RSS На сегодняшний день RSS остаются довольно популярным вариантом доставки новостей и контента пользователям. В связи с этим его используют почти на всех сайтах, где бывает более-менее периодическое обновление информации. А для нас это возможность быстро спарсить свежие обновления сайта, не анализируя сам сайт. И один из способов, как это сделать описан по ссылке выше.  Как фильтровать результат по определенным хедерам? Как известно, А-парсер предназначен для парсинга, в основном, текстовой информации. Но кроме этого им вполне реально парсить и другие обьекты (файлы, картинки и т.п.). При этом существует возможность фильтровать их по заголовкам ответа сервера. Об этом по ссылке выше.  Скачивание картинок указанного разрешения и размера Если выше мы фильтровали результат только по хедерам и рассматривали вариант с документами, то в данной статье мы будем скачивать картинки и фильтровать их по размеру и разрешению. Как это сделать - можно увидеть по ссылке выше.  Еще больше различных рецептов в нашем Каталоге примеров! Предыдущие сборники:

-------------------- |

|

|

|

AParser_Support

AParser_Support

|

18.8.2015, 10:52;

Ответить: AParser_Support 18.8.2015, 10:52;

Ответить: AParser_Support

Сообщение

#91

|

|

|

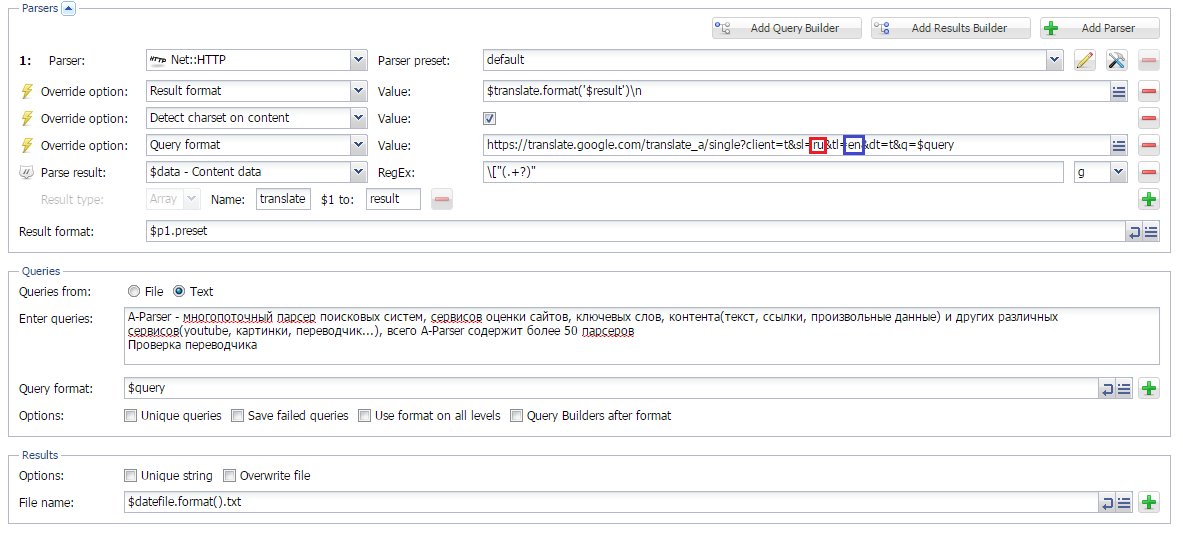

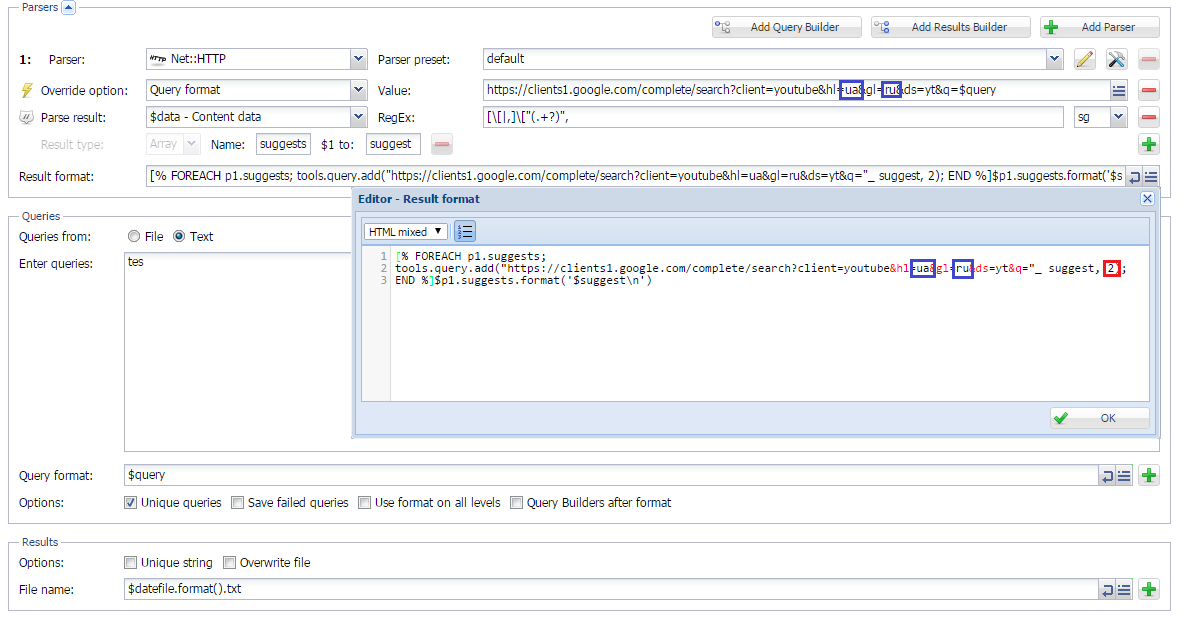

Сборник рецептов #8: парсим 2GIS, Google translate и подсказки Youtube

8-й выпуск сборника рецептов. В нем мы будем парсить базу организаций из каталога 2GIS, научимся парсить подсказки из Youtube и напишем кастомный парсер Google translate. Парсинг 2GIS 2GIS - это довольно большой справочник организаций России (и не только...) с возможностью просмотра их расположения на карте. База содержит более 1580000 организаций в 270 городах России. После парсинга представляет интерес как справочник сайтов, электронных адресов и телефонов организаций.  Парсинг Google Translate В данной статье рассмотрен способ написания кастомного парсера Google translate на основе  Net::HTTP. Также реализована возможность задавать направление перевода. Можно использовать для пакетного перевода больших обьемов текста. Net::HTTP. Также реализована возможность задавать направление перевода. Можно использовать для пакетного перевода больших обьемов текста. Парсинг подсказок Youtube Парсинг подсказок поисковых систем - довольно популярный способ поиска ключевых слов. В данной статье также используется  Net::HTTP, с помощью которого создается кастомный парсер подсказок Youtube. Реализована возможность задавать язык и страну, а также использовать уже спаршенные подсказки в качестве новых запросов на нужную глубину. Net::HTTP, с помощью которого создается кастомный парсер подсказок Youtube. Реализована возможность задавать язык и страну, а также использовать уже спаршенные подсказки в качестве новых запросов на нужную глубину. Еще больше различных рецептов в нашем Каталоге примеров! Предыдущие сборники:

-------------------- |

|

|

|

|

|

![]() Похожие темы

Похожие темы

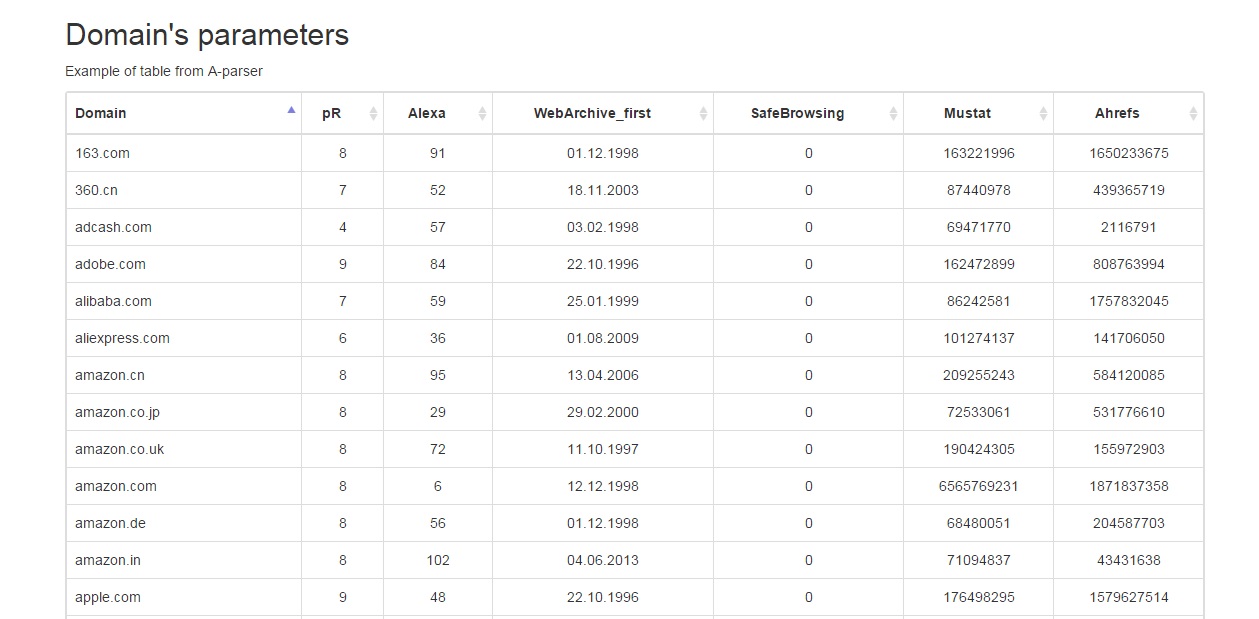

| Тема | Ответов | Автор | Просмотров | Последний ответ | |

|---|---|---|---|---|---|

|

Большие базы Semrush кейвордов по разным тематикам! Много кейвордов с трафиком и без конкуренции! Volume, KD, CPC | 23 | Krok | 6890 | Сегодня, 5:58 автор: Krok |

|

Базы Youtube кейвордов с данными по конкуренции и Volume | 6 | Krok | 1590 | 23.4.2024, 5:43 автор: Krok |

|

Бесплатный парсер бот в Телеграм - [Parser Pro] | 5 | Parser_Pro | 3354 | 27.1.2024, 16:12 автор: Parser_Pro |

|

Дайте бесплатного контента! :) | 2 | Tia2 | 1001 | 22.12.2023, 18:53 автор: zyzy |

|

Занимаюсь добычей качественного контента из Вебархива. Опыт уже более трех лет Предоставляю только качественный, читабельный контент. |

62 | kuz999 | 38121 | 27.7.2023, 13:55 автор: kuz999 |

|

Текстовая версия | Сейчас: 25.4.2024, 10:26 |